Firma Google ogłosiła niedawno mnóstwo aktualizacji swojego modelu Gemini AI, w tym kilka ulepszeń i nowych modeli. Wśród nich dużym zainteresowaniem cieszył się Gemini Live, multimodalny model sztucznej inteligencji obsługujący funkcje wideo i głosowe.

Odkąd w lutym nazwa Barda została zmieniona na Gemini, model AI zastępuje Asystenta Google na urządzeniach z Androidem. Jednak jego obecne możliwości są dość ograniczone. Dzięki Gemini Live Google chce to zmienić, oferując potężniejszy i bardziej wszechstronny model sztucznej inteligencji.

Czym jest Gemini Live?

Aby zapewnić użytkownikom lepszą obsługę sztucznej inteligencji i wykorzystać ulepszony ChatGPT GPT-4o OpenAI, firma Google ogłosiła niedawno Gemini Live na konferencji programistów I/O. Gemini Live umożliwi użytkownikom prowadzenie naturalnych i spersonalizowanych rozmów w czasie rzeczywistym za pośrednictwem głosu, a później wideo.

Nowy model sztucznej inteligencji jest częścią projektu Google Astra, który jest próbą giganta wyszukiwania polegającego na zbudowaniu uniwersalnego asystenta AI, który może wykorzystywać różne rodzaje danych wejściowych z życia codziennego do udzielania pomocy. Na przykład Gemini Live może wykorzystywać tekst, obrazy z aparatu w smartfonie i Twój głos, aby odpowiadać na pytania.

Według Google nowy model języka naturalnego nie tylko pomoże użytkownikom rozwiązywać problemy i wykonywać różne czynności, ale także będzie sprawiał wrażenie całkowicie naturalnego podczas interakcji. Użytkownicy będą mogli uruchomić Gemini Live, dotykając ikony głosu na swoim telefonie, co wyświetli sztuczną inteligencję na pełnym ekranie z efektem fali dźwiękowej.

Następnie możesz rozmawiać z sztuczną inteligencją tak samo, jak z prawdziwym osobistym asystentem. Doskonałym przykładem tego, jak ulepszony model sztucznej inteligencji może Ci pomóc, jest sytuacja, gdy poprosisz go o pomoc w przygotowaniu do rozmowy kwalifikacyjnej. Gemini Live zasugeruje umiejętności, które możesz wyróżnić, przekaże wskazówki dotyczące wystąpień publicznych i nie tylko.

Cechy

Gemini Live ma kilka funkcji, które czynią go znacznie lepszym asystentem AI niż Asystent Google, Siri firmy Apple czy Alexa firmy Amazon.

Dwukierunkowe rozmowy głosowe

Gemini Live pozwala z nim rozmawiać i zapewnia ludzkie odpowiedzi werbalne, co skutkuje wciągającymi i intuicyjnymi rozmowami. Możesz na przykład zapytać go o pogodę, a otrzymasz dokładną i zwięzłą aktualizację.

Możliwości inteligentnego asystenta

Model AI może służyć jako inteligentny asystent i wykonywać zadania takie jak podsumowywanie informacji z e-maili i aktualizacja kalendarza. Możesz na przykład zrobić zdjęcie ulotki koncertowej, a Gemini doda wydarzenie do Twojego kalendarza.

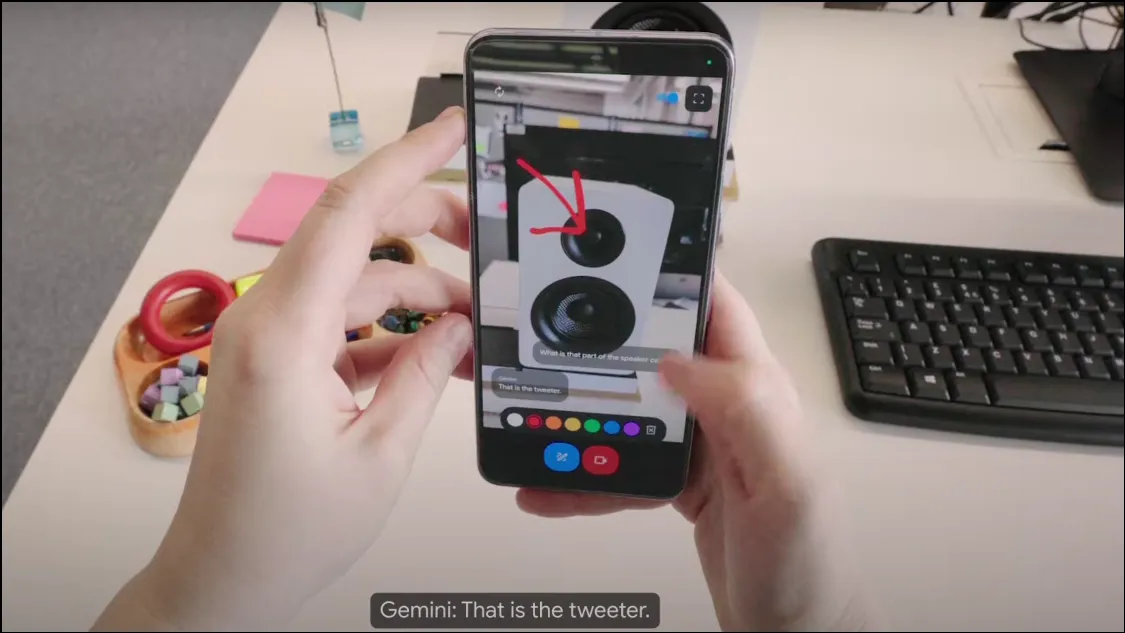

Możliwości wizualne

Korzystając z aparatu w smartfonie, Gemini Live może rejestrować filmy w czasie rzeczywistym. Dzięki temu może identyfikować obiekty i odpowiadać na pytania dotyczące ich. Na przykład, jeśli skierujesz aparat smartfona na głośnik i poprosisz Gemini o jego identyfikację, powie Ci, co to jest, a nawet określi jego markę i model.

Jak działa Gemini Live?

Project Astra może łączyć głosowe i wizualne dane wejściowe, dzięki czemu są łatwe do zrozumienia dla modelu AI. Może wówczas zareagować na informację i udzielić niezbędnej pomocy. Podobnie jak ChatGPT OpenAI oparty na GPT-4o, Gemini Live jest multimodalną sztuczną inteligencją i nie opiera się wyłącznie na tekście jako danych wejściowych.

Chociaż w początkowej wersji Gemini Live będzie początkowo korzystać z wprowadzania głosowego do gromadzenia i analizowania danych, w nadchodzących miesiącach zostanie zmodernizowany, aby przetwarzać i analizować również filmy wideo, dzieląc je klatka po klatce w celu lepszego zrozumienia i interakcji.

Sztuczna inteligencja może dostosować się do szybkości, z jaką mówią różni użytkownicy, a nawet możesz jej przerwać, aby poprosić o wyjaśnienia lub podać więcej informacji. Jego zdolność do naśladowania ludzkiego dialogu może zapewnić bardziej wciągającą interakcję. Dzięki temu można z nim w kółko rozmawiać, zupełnie jak z ludzkim asystentem. Dodatkowo będziesz mógł wybierać spośród dziesięciu różnych głosów AI.

GPT-4o vs. Bliźnięta na żywo

Chociaż zarówno GPT-4o, jak i Gemini Live to multimodalne modele sztucznej inteligencji, w tej chwili trudno stwierdzić, który z nich radzi sobie lepiej w prawdziwym życiu, zwłaszcza że żaden z nich nie jest obecnie publicznie dostępny.

Jednak w przeciwieństwie do ChatGPT, Gemini Live opiera się na innych modelach sztucznej inteligencji, takich jak Google Veo i Imagen 3, w celu dostarczania wyników w postaci filmów i obrazów. Mimo to w demonstracjach OpenAI i Google ChatGPT wydawał się bardziej naturalny, a nowy model GPT-4o potrafił nawet wykrywać i symulować ludzkie emocje za pomocą tonów wokalnych.

Dodatkowo może dostosować się do sposobu, w jaki chcesz odpowiadać, czego Gemini Live nie jest w stanie zrobić, przynajmniej w swoim obecnym stanie.

Dostępność na żywo w Gemini

Dla abonentów Gemini Advanced dostępny będzie Gemini Live, czyli płatna wersja chatbota AI. Zostanie on wdrożony w nadchodzących miesiącach i oczekuje się, że będzie powszechnie dostępny pod koniec roku.

Aplikacje takie jak Wiadomości Google będą mogły w pełni wykorzystywać możliwości Gemini Live, umożliwiając użytkownikom interakcję z sztuczną inteligencją bezpośrednio w aplikacji do przesyłania wiadomości.

Gemini Live może być kolejnym poważnym ulepszeniem chatbota Google AI i właśnie tym, czego potrzebuje, aby stawić czoła rywalom takim jak ChatGPT OpenAI. Dzięki funkcjonalności multimodalnej i zaawansowanym funkcjom mowy ulepszony model może pomóc Google osiągnąć sukces w dostarczaniu wszechstronnego i niezawodnego asystenta cyfrowego.

Na razie Google ogłosił jedynie, że udostępni płatnym subskrybentom nowy model AI. Chociaż pomija to bezpłatnych użytkowników, którzy stanowią ogromną część bazy użytkowników Google, mamy nadzieję, że Google zmieni swoje stanowisko i zdecyduje się rozszerzyć dostępność Gemini Live.

Dodaj komentarz