Firma Apple wprowadziła nową funkcję AI znaną jako Visual Intelligence, która ma zostać uruchomiona wraz z nadchodzącą aktualizacją iOS 18.2. Nasze praktyczne doświadczenie z najnowszą wersją beta ujawnia szereg ekscytujących możliwości. Visual Intelligence przekształca aparat w wyrafinowane narzędzie oparte na AI, podobne do Google Lens.

Czym właściwie jest inteligencja wizualna?

Podczas gdy Siri działa jako interaktywna sztuczna inteligencja reagująca na głos, która odpowiada na Twoje pytania, Visual Intelligence działa jako sztuczna inteligencja skoncentrowana na wzroku, umożliwiając Ci kierowanie kamery na różne przedmioty w celu zebrania informacji lub wykonania szybkich zadań.

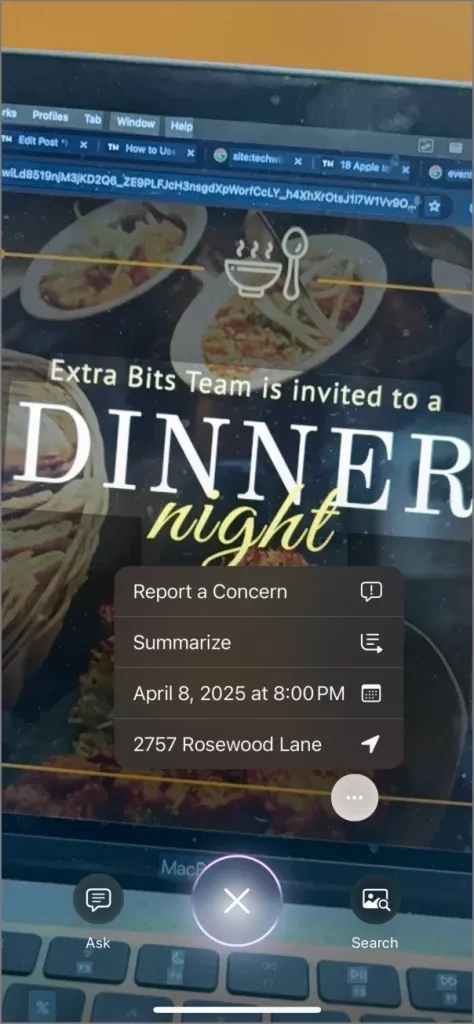

Na przykład skierowanie iPhone’a w stronę lokalu gastronomicznego może ujawnić jego oceny i godziny otwarcia pobrane bezpośrednio z Apple Maps, a nawet może wyświetlić jego menu. Podczas skanowania ulotki wydarzenia może automatycznie wyświetlić opcje dodania wydarzenia do Kalendarza lub uzyskania wskazówek dojazdu do lokalu, eliminując potrzebę ręcznego wprowadzania danych.

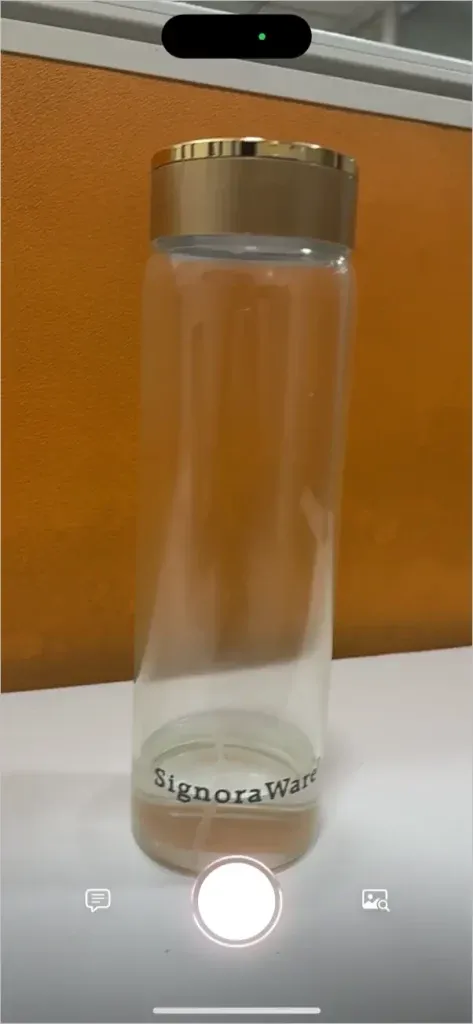

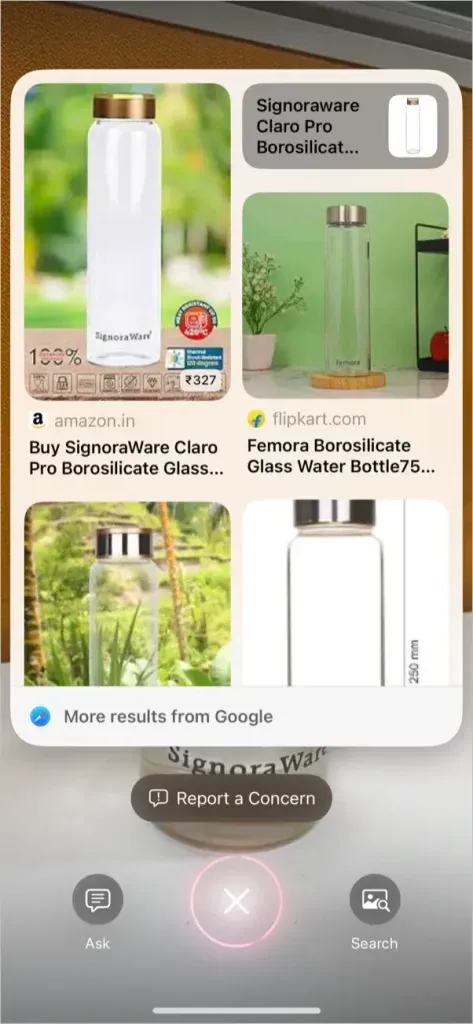

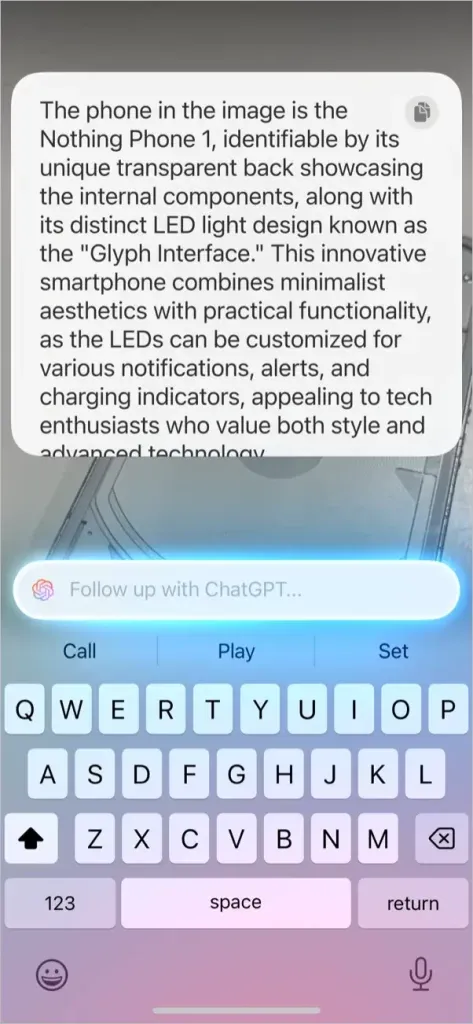

Wystarczy skierować kamerę na dowolny przedmiot, aby pobrać informacje za pomocą ChatGPT lub znaleźć podobne obrazy za pośrednictwem Google. Oznacza to, że możesz zidentyfikować rasę zwierzęcia lub rośliny, a nawet odkryć, gdzie kupić produkt online.

Rozważ Visual Intelligence jako wysoce zintegrowaną wersję Google Lens z wyraźnymi ulepszeniami od Apple. Ta funkcja jest jednak ograniczona do serii iPhone 16, która wykorzystuje możliwości układu A18.

Jak aktywować inteligencję wizualną

Możesz bezproblemowo uzyskać dostęp do Visual Intelligence za pomocą funkcji Camera Control na iPhonie 16. Stanowi ona część aktualizacji iOS 18.2, która jest obecnie w pierwszej wersji beta dla deweloperów i przewiduje się, że będzie publicznie dostępna do końca roku. Aby rozpocząć, przełącz się na kanał beta dla aktualizacji iOS 18.2 lub poczekaj na stabilną wersję.

- Długie naciśnięcie nowego przycisku sterowania kamerą powoduje wyświetlenie interfejsu przypominającego wizjer aparatu, zawierającego także opcje podglądu i przechwytywania obrazu.

- Po aktywacji skieruj kamerę na obiekt, o którym chcesz uzyskać informacje, i naciśnij przycisk przechwytywania , aby uruchomić funkcję Visual Intelligence.

- Niezależnie od tematu, zawsze zobaczysz dwie opcje: Zapytaj i Szukaj .

- Zapytaj : Wysyła obraz do ChatGPT , aby rozpocząć rozmowę i dowiedzieć się więcej.

- Szukaj : Używa wyszukiwarki Google, aby znaleźć podobne obrazy lub linki umożliwiające zakup podobnych przedmiotów online.

Wykorzystanie inteligencji wizualnej w codziennej rutynie

- Skieruj swojego iPhone’a na zabytek, aby wyświetlić jego nazwę, historię, godziny otwarcia i pobliskie udogodnienia.

- Użyj aparatu swojego iPhone’a, aby sfotografować okładkę książki lub produkt i skorzystaj z funkcji wyszukiwania , aby znaleźć recenzje, opcje zakupu i inne informacje.

- Skieruj swój telefon w stronę rośliny lub zwierzęcia i skorzystaj z funkcji Zapytaj lub Szukaj , aby zidentyfikować gatunek i uzyskać dodatkowe informacje, takie jak siedlisko, cechy gatunku lub sugestie dotyczące pielęgnacji.

- Skieruj kamerę na plakat wydarzenia, a funkcja Visual Intelligence wyodrębni nazwę, godzinę, datę i lokalizację wydarzenia, dając możliwość dodania ich bezpośrednio do kalendarza .

- Jeśli natrafisz na dłuższy tekst, po prostu skieruj na niego swoją kamerę, aby otrzymać szybkie podsumowanie, lub pozwól aplikacji ChatGPT wyjaśnić go prostszym językiem.

Chociaż Visual Intelligence jest niezwykle przydatnym narzędziem, ma pewne ograniczenia. Na przykład, w przeciwieństwie do Google Lens, obecnie brakuje mu opcji nagrywania wideo, która umożliwia wyszukiwanie na żywo dużych obiektów. Miejmy nadzieję, że przyszłe aktualizacje rozwiążą tę funkcję.

31 ukrytych funkcji iOS 18, które musisz sprawdzić

Dodaj komentarz